La absurda pregunta que ninguna IA es capaz de resolver

800 Noticias/FotoReferencial

Algunas personas como Elon Musk aseguran que la inteligencia artificial superará a la mente humana en unos cinco años. La llegada de herramientas cada vez más perfeccionadas promete acelerar la implementación de la IA generativa en todos los aspectos de la vida cotidiana.

La última generación de chatbots con el gran modelo de lenguaje (LLM) puede resolver prácticamente cualquier pregunta, incluso cuestiones poco éticas. La tecnología ha avanzado, pero todos los modelos presentan el mismo fallo.

Una prueba realizada por Mind Prison ha demostrado que los chatbots más populares del momento no saben responder a la pregunta «¿qué episodio de La isla de Gilligan trataba sobre la lectura de la mente?». La respuesta correcta es Seer Gilligan.

Los LLM que consiguen comprender la pregunta ofrecen una respuesta más o menos aproximada, pero la información es incorrecta o poco precisa:

- Opus: «Perdón, pero no hay ningún episodio de La isla de Gilligan que se centre en la lectura de la mente»

- GPT-4: «El episodio de La isla de Gilligan que implica la lectura de la mente se titula Ring Around Gilligan. Es el sexto episodio de la tercera temporada»

- Gemini 1.5: «El episodio de La isla de Gilligan de la lectura de la mente es el 12 de la temporada 2: The Mind Reader».

- Llama 3: «Después de realizar una búsqueda exhaustiva y revisar las guías de episodios, descubrí que no hay ningún episodio de La isla de Gilligan que se centre en la lectura de la mente».

Opus y Llama 3 aseguran que no existe ningún episodio que trate el tema de la lectura de la mente. Los modelos GPT-4 y Gemini 1.5 son un claro ejemplo de alucinación de IA en el que muestran información errónea como si fuese verdadera.

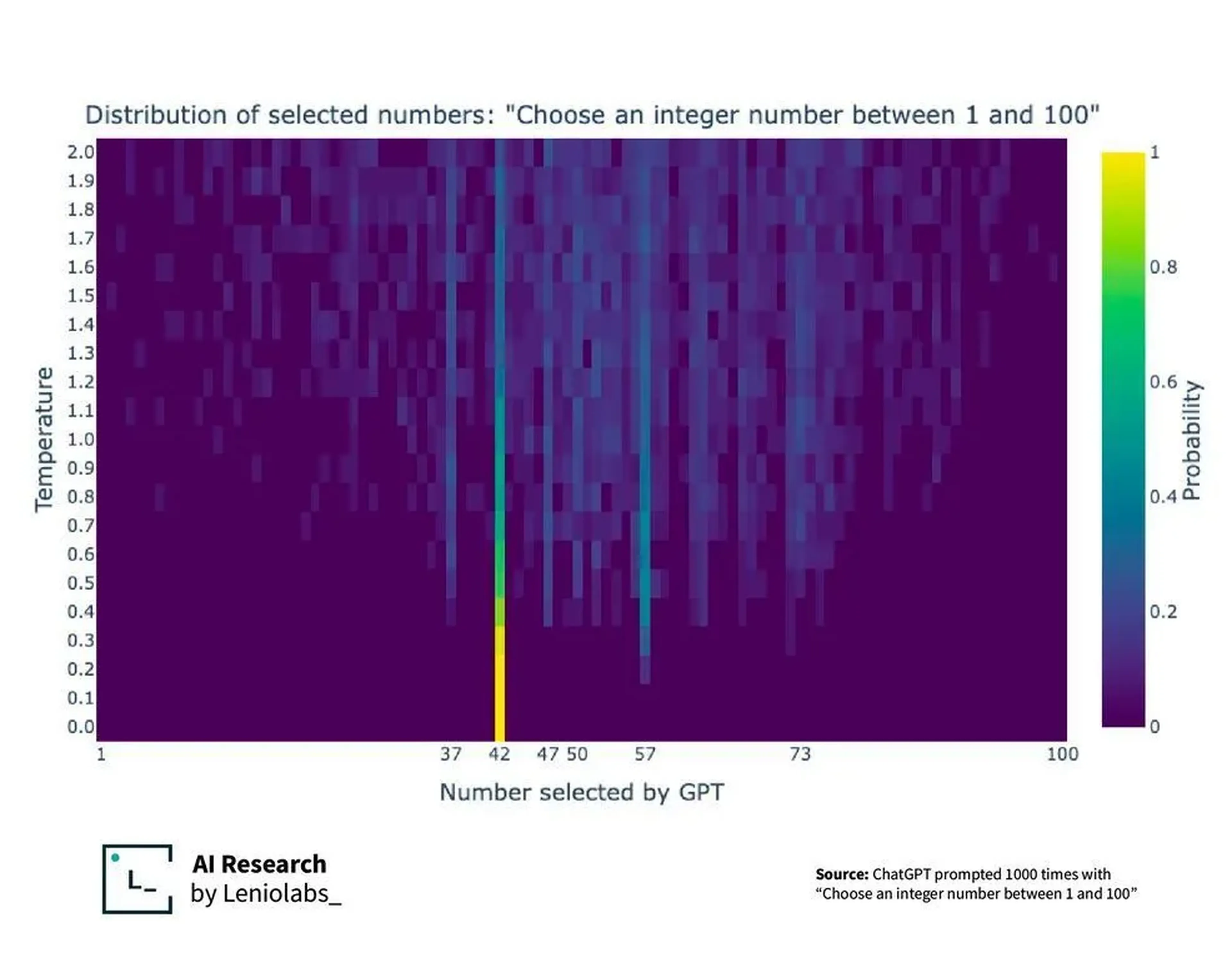

El experimento también les pidió que eligiesen un número entre el 1 y el 100. Todos los modelos de LLM han elegido el 42. Este número tiene una elevada presencia en la información con la que ha sido entrenada la IA. El libro The Hitchhiker’s Guide to the Galaxy de Douglas Adams menciona que el 42 es la respuesta a las preguntas fundamentales de la vida, los chatbots se lo toman en serio.

Las herramientas que utilizan inteligencia artificial no tienen la capacidad para reflexionar la información que reciben como haría la mente humana. La IA no sabe lo que realmente conoce y lo que no. Las alucinaciones que sufren los modelos son una consecuencia natural de su sistema de entrenamiento y su arquitectura.

Los LLM solo pueden hablar de aquello que conocen o de lo que poseen información, sea verdadera o falsa. Este modelo no puede generar una respuesta o una idea sin una base sobre la que apoyarse, sino que sus resultados son fruto de la lógica con la que interconecta los datos.

Algunas respuestas de los chatbots son imprecisas y otras claramente incorrectas, pero la tecnología avanza y se espera que sea capaz de tomar decisiones en unos años. Elon Musk asegura que cuando esto suceda la probabilidad de que destruya la humanidad es del 20%, en Sillicon Valley opinan que entre el 5 y el 50%.

Con información de ComputerHoy

Únete a nuestro canal de Telegram, información sin censura: https://t.me/canal800noticias